Изменения в поисковых системах, такие как обновления алгоритмов и другие нововведения происходят в последнее время регулярно. В этой статье хотелось бы рассказать о всех изменениях в поисковой системе Google за 2012 год. Больше всего этот обзор касается изменений в SEO, таких как: факторы ранжирования, фильтры, взаимодействие с вебмастерами, новые функции в панели для вебмастеров и т.д.

Изменения в поисковых системах, такие как обновления алгоритмов и другие нововведения происходят в последнее время регулярно. В этой статье хотелось бы рассказать о всех изменениях в поисковой системе Google за 2012 год. Больше всего этот обзор касается изменений в SEO, таких как: факторы ранжирования, фильтры, взаимодействие с вебмастерами, новые функции в панели для вебмастеров и т.д.

Борба со спамом. За этот год Google сделал большой шаг вперёд в борьбе со спамом. Низкокачественные сайты, а так же сайты, использующие спамные методы продвижения в том или ином виде, Google заметно прижал.

Отказ от учёта точного вхождения запроса в домен сайта. Влияние этого фактора скоро будет снижено до ноля, то есть ключевой запрос в домене никак не будет влиять на ранжирование сайта. Об этом месяц назад заявил Мэтт Каттс, главный специалист Google по борьбе со спамом.

Индексирование JavaScript и AJAX. Теперь Google индексирует подобные вещи, и то, что раньше прятали с помощью таких скриптов, Гугл теперь «видит».

Google стал ближе к народу. Круг сообщений, получаемых сайтовладельцами через гугловскую панель инструментов для вебмастеров заметно расширился. Сейчас это и сообщения о проблемах с сайтами, предупредительные сообщения, уведомления если сайт нарушает какие-либо правила, ошибки, недоступность и т.д. и т.п.

Google стал ближе к народу. Круг сообщений, получаемых сайтовладельцами через гугловскую панель инструментов для вебмастеров заметно расширился. Сейчас это и сообщения о проблемах с сайтами, предупредительные сообщения, уведомления если сайт нарушает какие-либо правила, ошибки, недоступность и т.д. и т.п.

Выбор канонических страниц. Теперь Gooogle может определять канонические урлы самостоятельно, без оглядки на соответствующие указания в коде документов от вебмастеров, хотя и принимает их во внимание.

Алгоритм Panda. Этот алгоритм пессимизирует низкокачественные сайты. Наказывает ресурсы с некачественными текстами, либо за низкую уникальность, либо за страницы почти одинакового содержания, дубли контента, сайты с генерируем содержанием и т.д. Запущена Panda была в 2011 году и постоянно обновлялась, в том числе и не один раз в этом году.

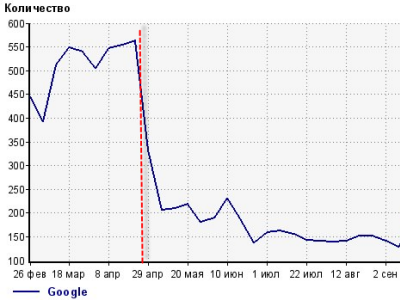

Алгоритм Penguin (пингвин). Про это чудо не слышал разве только очень далёкий от seo человек. Данный алгоритм, включенный в поисковый алгоритм Google 24 апреля 2012 года, моментально «вынес» с позиций огромную массу сайтов во всём мире. Пингвин пессимизировал сайты (понижал позиции в поиске), использующие для продвижения спамные ссылки и т.д.

Алгоритм Penguin (пингвин). Про это чудо не слышал разве только очень далёкий от seo человек. Данный алгоритм, включенный в поисковый алгоритм Google 24 апреля 2012 года, моментально «вынес» с позиций огромную массу сайтов во всём мире. Пингвин пессимизировал сайты (понижал позиции в поиске), использующие для продвижения спамные ссылки и т.д.

За что наказывал и наказывает пингвин:

- неестественные ссылки, влияющие на результаты поиска

- большое количество входящих ссылок с точным вхождением в анкор продвигаемых запросов

- ссылки с нетематичных статей и сайтов

- неестественные сквозняки с вхождением ключа

- спамные ссылки

- дубли страниц

- переспам

Основное, за что наказывает данный алгоритм — неестественные входящие спамные ссылки. Если сайт попал под Penguin, а на статистике посещаемости сайта это выглядит примерно так —

— то вывести сайт из под этого фильтра очень сложно.

В ответ на волну недовольства вебмастеров, предъявивших Гуглу на это в общем то вполне разумные доводы о том, что за внешние ссылки они отвечать не имеют возможностей (их могут ставить и конкуренты), Google ввёл инструмент, который называется «Отклонение ссылок».

Инструмент «Отклонение ссылок». Если обнаружены нежелательные ссылки, которые указывают на наш ресурс, с помощью данного инструмента мы имеем возможность отклонить эти ссылки, то есть сделать так, чтобы Google их не учитывал. Заходим в «Отклонение ссылок» и отправляем в Google текстовый файл, в котором указаны адреса страниц, содержащих нежелательные ссылки на наш ресурс (каждый урл в файле с новой строки).

Наказание за большое количество рекламы в верхней части страниц сайта. Если для просмотра основного содержимого сайта пользователю будет требоваться прокрутка вниз из-за наличия рекламы, сайт может быть пессимизирован.

Борьба с засильем одного сайта в топе по запросу. С сентября Google начинает кампанию против формирования выдачи, включающей страницы одного и того же сайта. То есть в топах (и не только) теперь не будет несколько страниц одного и того же сайта, что раньше было в порядке вещей.

Борьба с пиратством. Наказание за содержимое сайта, нарушающее авторские права. Конец варезникам.

Переоптимизация сайта/страницы. За большое количество ключевых слов на странице Google будет наказывать жёстче. Если алгоритм посчитает, что большое количество вхождений ключевых слов создано только для манипулирования выдачей, а не для удобства посетителей — последуют санкции. В том числе этот фильтр может быть наложен в ручном режиме.

Как относится Google к входящим ссылкам?

Категория:

Категория:

Видео очень интересное. И вся статья — супер. СПС.

Кстати, относительно борьбы с засильем сайта в топе. Очень заинтересовало. Бывали времена, когда в 10-ке было 5 моих страниц. А месяц назад их выкосило под корень. Осталась только одна (и как на зло не главная). Борюсь с этим месяц. Пока без результатов. :- ((((.

Gosha_trade, thanks)

Если вы про Гугл то результатов можете и не дождаться. Данное обновление прикручено и работает с сентября (борьба с засильем).

Кстати, более подробно обо всём этом, если есть желание —

http://searchengineland.com/2012-google-seo-year-in-review-139780

Да уж, алгоритмы Гугла постоянно развиваются. С одной стороны хорошо, потому что выдача становится более человечной. С другой стороны, жизнь оптимизатора становится все сложнее.

happyweblife, конечно, как и алгоритмы всех остальных поисковиков.

Если не развивать — выдача будет такая, которая нужна оптимизаторам, а не поисковой системе Google) Чего гугл конечно же не допустит. Это ведь средство заработка для тех и других.